Le son nous entoure au quotidien, nous permettant de discuter, d’écouter de la musique, éviter des dangers, identifier des problèmes…

Un paysage sonore est un ensemble de sources sonores qui chacune rayonne un signal acoustique qui se propage dans l’environnement. Après de nombreuses réflexions sur des parois, modifications liées aux nombreux objets présents dans l’environnement, certains rayons vont atteindre nos deux oreilles. C’est à partir de cette “mixture” sonore que nous allons reconnaître toutes ces sources sonores, mais également nous représenter toute la scène, mentalement, rien qu’en utilisant la modalité sonore.

Pour cela, l’humain utilise de nombreux éléments, entre l’oreille et le système nerveux central. Et chaque élément a un rôle particulier dans le traitement du signal acoustique pour extraire toutes ces informations. Quelles sont les sources présentes ? Où sont-elles situées ? Sont-elles mobiles ?

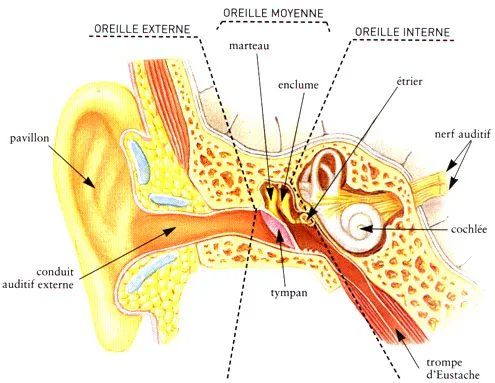

Le système auditif

Nous pouvons décrire notre système auditif en trois éléments, notre oreille, les voies auditives et le cortex auditif.

Notre oreille a pour objectif de capter l’information acoustique, la traduire en un signal électrique, pouvant être analysé par notre système nerveux, puis commencer une première phase de traitement, relativement simple mais essentielle pour extraire des informations, l’analyse temps-fréquence. En effet, l’ensemble des informations transmises sur le nerf auditif, va être organisé de la fréquence la plus grave à la fréquence la plus aiguë, et séparé dans le temps pour permettre un traitement facilité par le système nerveux. C’est la “tonotopie” réalisée par la Cochlée située dans l’oreille interne.

Ces informations sont ensuite augmentées et modifiées durant leur trajet à travers les voies auditives jusqu’au système nerveux central. En effet, c’est lors de ce trajet que les informations provenant de nos deux oreilles sont associées pour permettre une localisation des sources sonores. Étonnamment, un message peut également faire le trajet inverse pour “adapter” le fonctionnement de notre audition, par exemple en orientant notre attention vers une source particulière comme une voix, mais également en atténuant l’influence du milieu, comme la réverbération d’une pièce.

Enfin, le cortex auditif, va lui organiser ce flux d’information pour faciliter l’extraction des informations et ainsi permettre de représenter de manière cohérente toutes ces informations; c’est ce que l’on appelle l’analyse des scènes auditives. Des éléments simultanés sont utilisés pour séparer les sources sonores tandis que d’autres éléments sont fusionnés en objets auditifs. Ces objets sont ensuite comparés à des schémas dans notre mémoire pour faciliter l’identification de ces sources sonores puis associés en séquence pour extraire un sens à cet environnement sonore (phrase, mélodie, etc). Il est important de noter que le long des voies auditives et au niveau du cortex auditif, existe des liens vers les autres modalités perçues (en particulier la vision), facilitant l’extraction des informations à partir du flux auditif. Enfin, les mouvements de la tête, la localisation puis l’orientation dans l’axe de la source sonore donnent également de nombreuses informations.

Les défis de la compréhension du son avec des algorithmes

Les méthodes de reconnaissance des événements sonores automatisées, qui sont notre spécialité chez Wavely, ne font que reproduire ces trois étapes par une série d’algorithmes de pré-traitement, d’extraction d’éléments représentatifs puis d’identification. Cependant, la plasticité du cerveau humain, la possibilité de modifier en temps réel son attention, la banque de “schémas” acquises au fil des années sont des éléments clés dans le fonctionnement humain… et autant de défis à relever pour reproduire cette compréhension de façon automatisée !

📧 contact@wavely.fr ou par téléphone 📞 03.62.26.39.08